Оглавление

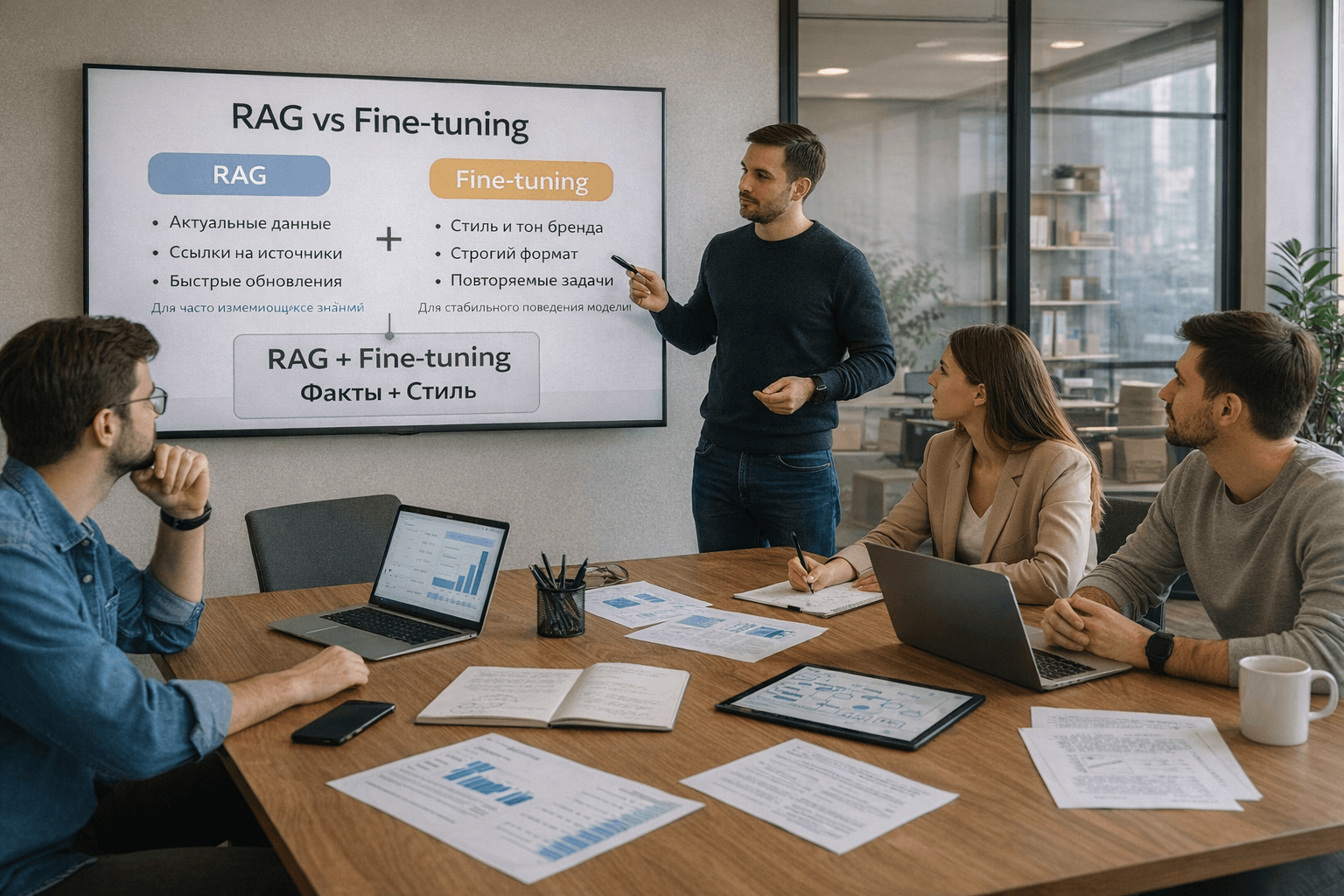

- Почему вокруг Fine-tuning и RAG столько путаницы

- Что такое RAG простыми словами

- Что такое Fine-tuning и за что его действительно ценят

- Когда RAG почти всегда лучше Fine-tuning

- Когда Fine-tuning действительно оправдан

- Где ошибаются чаще всего

- Когда лучший выбор — связка RAG + Fine-tuning

- Как понять, что выбрать: практический чек-лист

- С чего начать, если вы строите систему сейчас

- Инфраструктура тоже имеет значение

- Вывод

Введение

У большинства команд путь в AI начинается одинаково: берут сильную языковую модель, подключают свои данные и ждут, что она сразу станет умным корпоративным ассистентом, техподдержкой и аналитиком в одном лице. А дальше приходит первая путаница. Одни говорят: «Нужно дообучить модель на наших данных». Другие отвечают: «Нет, достаточно RAG». В результате бизнес тратит недели на споры, а инженеры — месяцы на не тот стек.

Проблема в том, что fine-tuning и RAG решают разные задачи. Это не два конкурента на одном ринге, а два инструмента из одного ящика. Молоток не лучше отвертки просто потому, что он тяжелее. И наоборот.

Если выбрать подход наугад, можно получить дорогую систему, которая уверенно ошибается, или быструю систему, которая знает все документы, но не умеет говорить в нужном стиле. Ниже разберем без магии и маркетингового тумана: когда модель действительно стоит дообучать, когда лучше строить индекс, а когда выигрыш дает только их связка.

Почему вокруг Fine-tuning и RAG столько путаницы

Снаружи все выглядит просто. Есть данные компании: база знаний, переписки, инструкции, каталоги, статьи, регламенты. Кажется логичным «скормить все это модели», и она станет умнее. Но здесь и прячется главное недоразумение.

Языковая модель не хранит знания так, как это делает поисковая система или база документов. Когда вы делаете fine-tuning, вы не заливаете в нее папку с PDF и не создаете встроенный Google Drive в голове модели. Вы меняете ее поведение: как она отвечает, на что обращает внимание, какие шаблоны считает правильными, как формулирует мысли, насколько уверенно держит формат.

RAG устроен иначе. Он не переписывает модель изнутри, а подает ей нужный контекст в момент запроса. Сначала система ищет релевантные фрагменты в индексе, потом передает их в промпт, и уже на основе этих данных модель строит ответ.

Если упростить до бытовой аналогии, fine-tuning — это как обучение сотрудника манере работы, стилю общения и правилам принятия решений. RAG — это как дать этому сотруднику быстрый доступ к актуальному архиву, CRM, wiki и внутренним инструкциям.

Готовы перейти на современную серверную инфраструктуру?

В King Servers мы предлагаем серверы как на AMD EPYC, так и на Intel Xeon, с гибкими конфигурациями под любые задачи — от виртуализации и веб-хостинга до S3-хранилищ и кластеров хранения данных.

- S3-совместимое хранилище для резервных копий

- Панель управления, API, масштабируемость

- Поддержку 24/7 и помощь в выборе конфигурации

Результат регистрации

...

Создайте аккаунт

Быстрая регистрация для доступа к инфраструктуре

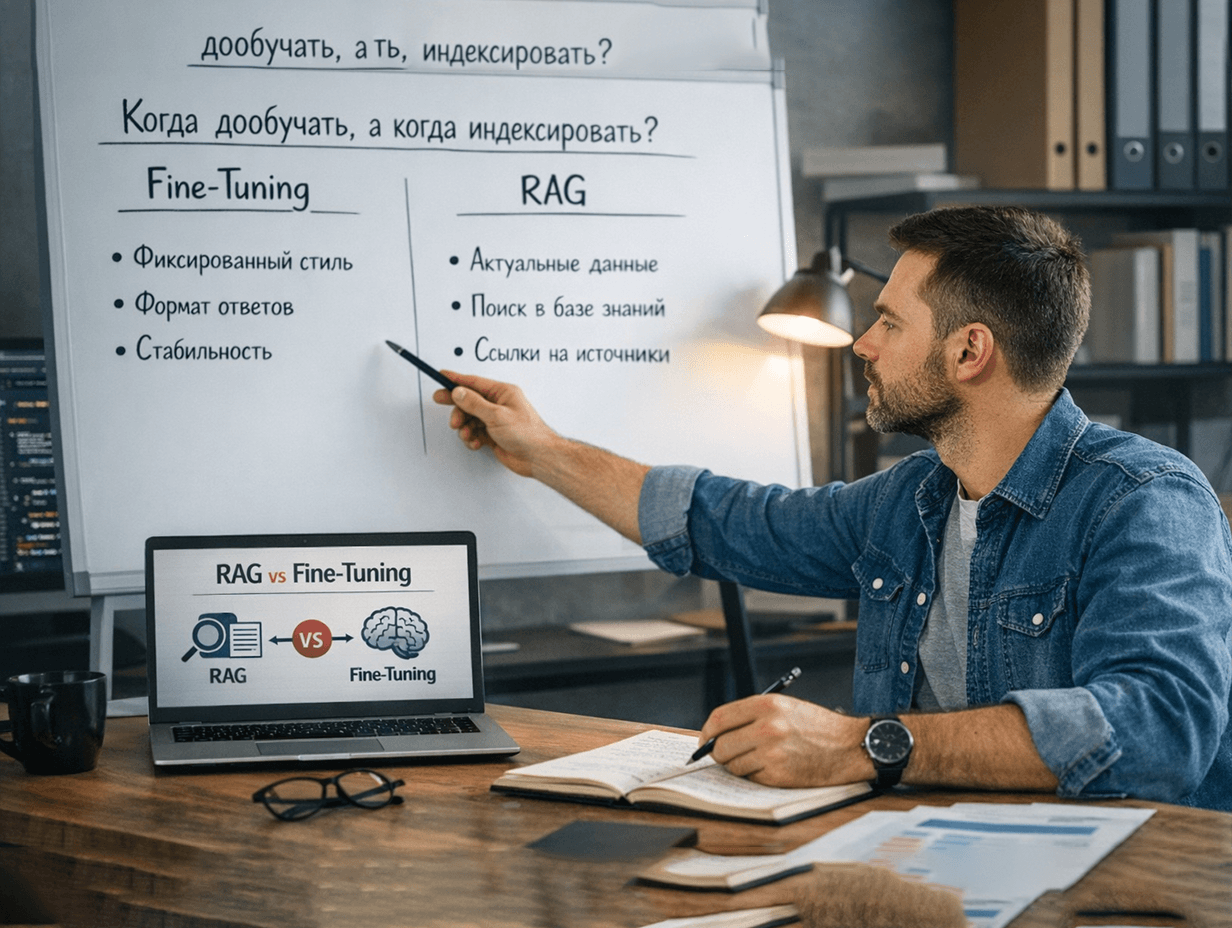

Оба подхода полезны. Но они отвечают на разные вопросы:

Когда нужен Fine-tuning

Когда важно как именно модель отвечает.

Когда нужен RAG

Когда важно, на каких данных она отвечает прямо сейчас.

На практике компании часто путают эти два слоя. Например, хотят, чтобы бот знал свежие цены из каталога, и думают про дообучение. Хотя цены меняются каждую неделю, а значит логичнее не переплавлять модель заново, а подключить актуальный индекс. Или наоборот: хотят стабильный тон бренда, единый формат карточек, аккуратные юридические формулировки, но пытаются решить это одним RAG. В итоге документы подставляются верно, а стиль «плавает».

Именно здесь и начинается зрелая архитектура: не с вопроса «что моднее?», а с вопроса «что именно мы пытаемся улучшить?».

Что такое RAG простыми словами

RAG, или Retrieval-Augmented Generation, — это генерация с опорой на найденные данные. Пользователь задает вопрос, система ищет релевантные куски информации в базе знаний, а затем передает их модели как контекст.

На словах это звучит скромно. На деле — это один из самых практичных способов превратить LLM в полезный рабочий инструмент.

Представьте юриста, которому задали вопрос по договору. Он не обязан помнить наизусть все редакции всех шаблонов за три года. Ему важнее быстро открыть нужный документ, найти актуальный пункт и на его основе ответить. Примерно так и работает RAG.

Что дает RAG бизнесу

Во-первых, актуальность. Если данные обновились утром, бот может использовать новую версию уже сегодня, без переобучения модели.

Во-вторых, прозрачность. Хорошая RAG-система умеет показать, на какие источники она опиралась. Для бизнеса это не мелочь, а вопрос доверия. Особенно в поддержке, медицине, финансах, юридических сервисах и B2B-продуктах.

В-третьих, экономию. Подключить индекс документов часто дешевле и быстрее, чем запускать цикл подготовки датасета, fine-tuning, валидации и последующего обслуживания модели.

Где RAG особенно силен

RAG отлично работает там, где знания часто меняются:

- внутренняя база знаний компании;

- инструкции для сотрудников;

- товарные каталоги и спецификации;

- документация по API;

- FAQ и база поддержки;

- юридические шаблоны и регламенты;

- аналитические отчеты;

- архивы тикетов и кейсов.

Здесь важен не «характер» модели, а ее доступ к свежим фактам.

Мини-кейс

Интернет-магазин запускает AI-консультанта. Пользователь спрашивает: «Есть ли в наличии видеокарта с 16 ГБ памяти и доставкой в Варшаву?»

Если компания выберет fine-tuning как основной путь, модель может хорошо разговаривать, но будет знать только тот срез каталога, на котором ее обучали. Через неделю часть товаров исчезнет, цены изменятся, условия доставки обновятся.

RAG решает задачу аккуратнее: берет данные из текущего каталога, складской системы и условий доставки, а затем формирует ответ на основе свежего контекста. Это уже не догадка, а рабочий процесс.

Что такое Fine-tuning и за что его действительно ценят

Fine-tuning — это дообучение базовой модели на специальном наборе примеров. Но здесь важно не попасть в старую ловушку: fine-tuning — не волшебный пылесос для загрузки всех знаний компании.

Его сила в другом. Он помогает модели закрепить нужное поведение.

Допустим, у вас есть служба поддержки SaaS-платформы. Все ответы должны быть спокойными, точными, без лишней импровизации, с понятной структурой: сначала короткий вывод, потом шаги, потом предупреждение о рисках. Более того, компания не хочет, чтобы бот «размышлял вслух» или отвечал в стиле свободной дискуссии. Она хочет узнаваемую, дисциплинированную подачу.

Вот здесь fine-tuning действительно уместен. Он помогает выровнять:

- стиль и тональность;

- формат ответа;

- устойчивость к шумным формулировкам;

- следование корпоративным правилам;

- обработку узкоспециализированных интентов;

- качество на повторяющихся типах задач.

Важная мысль, которую часто упускают

Fine-tuning не столько «добавляет знания», сколько «перенастраивает привычки» модели.

Хорошая аналогия — обучение оператора колл-центра. Вы не заставляете человека запоминать все документы мира. Вы учите его отвечать по стандарту: в каком порядке уточнять проблему, как формулировать рекомендации, что нельзя обещать клиенту, когда эскалировать тикет.

Именно поэтому fine-tuning особенно полезен, когда задача повторяемая, формат стабилен, а желаемое поведение можно показать на сотнях или тысячах хороших примеров.

Где Fine-tuning раскрывается лучше всего

Наиболее логичные сценарии:

- генерация в строго заданном стиле бренда;

- классификация и роутинг запросов;

- структурированные ответы в фиксированном формате;

- извлечение нужных сущностей из текста;

- переписывание контента по редакционным правилам;

- отраслевые помощники с узким поведенческим шаблоном;

- автоматизация типовых операций, где важна стабильность.

Например, если вы хотите, чтобы модель из неструктурированного обращения клиента всегда собирала карточку инцидента в одном шаблоне — с приоритетом, категорией, кратким резюме, возможной причиной и следующими действиями, — fine-tuning может дать очень заметный прирост качества. RAG сам по себе такую дисциплину не гарантирует.

Когда RAG почти всегда лучше Fine-tuning

Есть целый класс задач, где идея «давайте дообучим модель» выглядит эффектно, но на деле приносит больше хлопот, чем пользы.

1. Когда данные часто меняются

Это главный и самый очевидный критерий.

Если база знаний живет, обновляется, растет, пересматривается и теряет актуальность, зашивать ее в веса модели — все равно что печатать карту города каждое утро заново. Можно, конечно. Но зачем, если есть навигатор?

Свежие цены, остатки на складе, политика возвратов, SLA, внутренние регламенты, список доступных тарифов, релизы продукта — все это естественная территория RAG.

2. Когда важны ссылки на источник

Во многих бизнес-процессах одного «правдоподобного ответа» уже недостаточно. Нужны основания.

Если AI-помощник консультирует сотрудников по HR-политикам, информационной безопасности или юридическим оговоркам, человеку важно увидеть: на какой документ опирается ответ, где это прописано, какая версия действующая. Fine-tuning не дает такой прозрачности сам по себе. А RAG изначально строится вокруг извлечения конкретного контекста.

3. Когда база знаний слишком велика

Если у вас десятки тысяч документов, сотни тысяч страниц или массив неструктурированных данных из разных систем, fine-tuning становится дорогим и неуклюжим путем. Подготовка датасета начинает напоминать генеральную уборку в архиве без гарантии, что после нее вы легко найдете нужную папку.

RAG масштабируется в таких сценариях лучше. Особенно если грамотно сделать чанкинг, фильтрацию, reranking и политику доступа.

4. Когда задача — отвечать на вопросы по документам

Это классический случай. Пользователь спрашивает: «Какие ограничения у тарифа Business?», «Что меняется в версии API 2.3?», «Какой срок хранения логов по новой политике?»

Если ответ зависит от конкретного документа, его версии и формулировки, RAG почти всегда уместнее.

Мини-кейс

У провайдера есть база инструкций для клиентов: аренда серверов, настройка сети, резервное копирование, безопасность, лицензии, биллинг. Часть документов обновляется после каждого крупного релиза панели или изменения условий услуги.

Если строить AI-помощника для ответов по этим материалам, RAG даст быстрый путь к результату. Он сможет опираться на актуальные статьи и заметки, а команда — обновлять базу без запуска новых циклов обучения. Это тот случай, где индекс работает как живая библиотека, а не как музейный каталог.

Когда Fine-tuning действительно оправдан

Есть и обратная ошибка: видеть RAG как универсальную таблетку. Она тоже не всегда помогает.

Если проблема не в доступе к знаниям, а в нестабильном поведении модели, индекс сам по себе ситуацию не спасет.

1. Когда нужно строгое следование формату

Представьте финансовый сервис, где AI должен из входящего письма строить структурированный отчет: тип обращения, категория риска, страна, валюта, уровень срочности, рекомендуемое действие. Формат один и тот же, день за днем.

Да, можно пытаться дожимать это промптами. Но в какой-то момент количество заплаток начинает жить своей жизнью. Fine-tuning здесь часто дает более аккуратный и предсказуемый результат.

2. Когда важен устойчивый tone of voice

Брендовый стиль — тонкая штука. Его трудно удерживать на одном промпте, особенно под нагрузкой, на разных языках и в длинных диалогах. Если компания хочет, чтобы AI писал как единый голос продукта, а не как «иногда собранный редактор, иногда вдохновленный форумный эксперт», fine-tuning может быть очень полезен.

3. Когда задача повторяется тысячами однотипных запросов

Если входы похожи, выходы ожидаемы, а качество нужно стабилизировать, дообучение оправдано. Например:

- нормализация тикетов поддержки;

- классификация лидов;

- анализ отзывов по фиксированной схеме;

- извлечение полей из документов;

- генерация коротких резюме в одном стандарте.

В таких задачах модель не должна быть энциклопедией. Она должна быть хорошо натренированным сотрудником.

4. Когда нужно сократить зависимость от длинных промптов

Иногда система начинает напоминать походный рюкзак, в который напихали слишком много инструкций. Большой system prompt, длинные примеры, куча правил, контекст, ограничения — и все это ради того, чтобы модель ответила в нужном формате.

Fine-tuning позволяет часть этих правил перенести из промпта в само поведение модели. Это может снизить стоимость inference, уменьшить задержки и улучшить стабильность.

Мини-кейс

У компании есть AI-ассистент для первой линии поддержки. Он не ищет ответы по тысячам документов. Его задача уже скромнее: принять обращение, распознать тип проблемы, уточнить недостающие данные и передать в нужную очередь по внутреннему шаблону.

Здесь RAG не играет первую скрипку. Ключевая ценность — дисциплина процесса. Fine-tuning на качественном датасете диалогов и разметки может дать гораздо больше, чем подключение большой базы знаний.

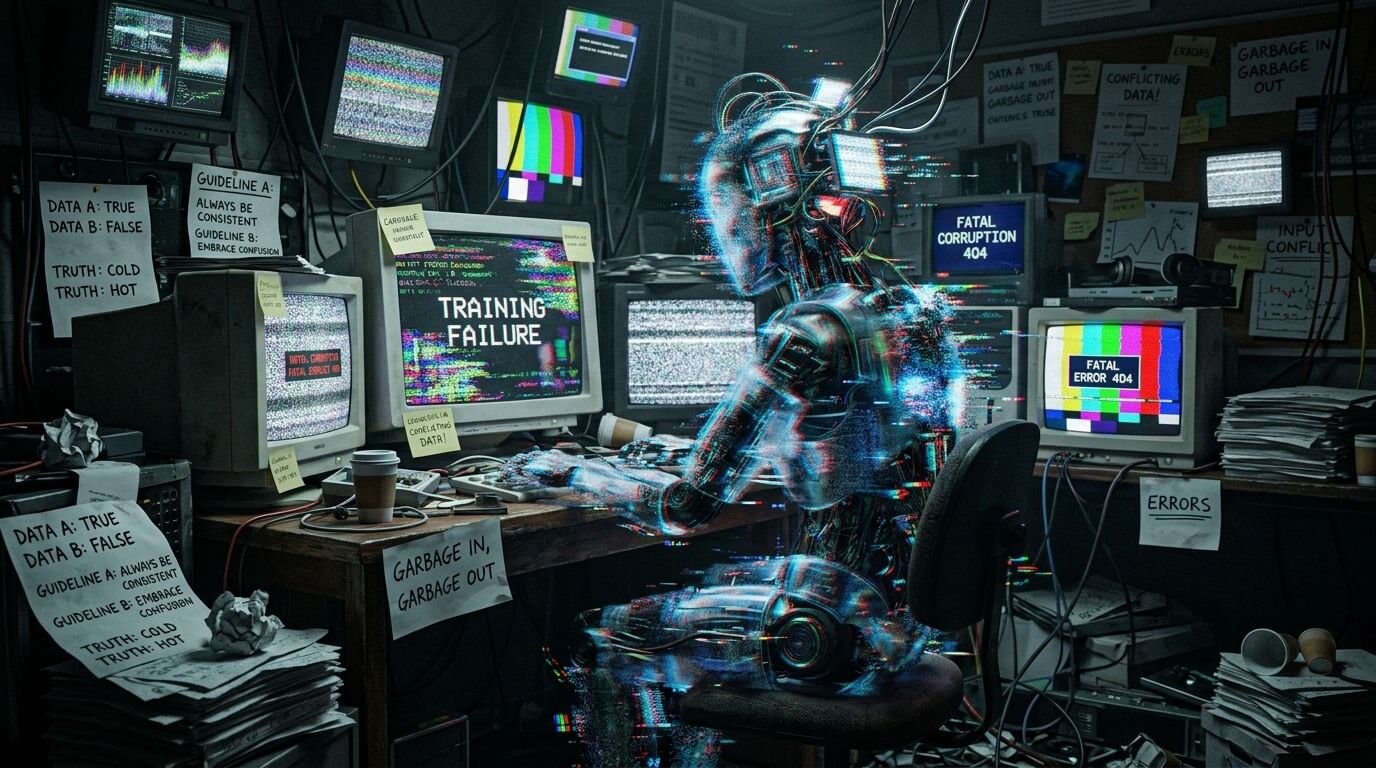

Где ошибаются чаще всего

На этом этапе возникает соблазн сказать: «Все понятно. Для знаний — RAG, для стиля — fine-tuning». Это хорошее правило, но в жизни все немного интереснее.

Ошибка №1. Пытаться лечить отсутствие данных дообучением

Если у модели нет доступа к актуальной информации, дообучение не сделает чудо. Оно может научить ее говорить убедительнее, но не даст доступ к свежим документам. В худшем случае вы получите красиво сформулированные устаревшие ответы.

Ошибка №2. Верить, что RAG автоматически убирает галлюцинации

RAG помогает, но не гарантирует абсолютную фактическую чистоту. Если retrieval слабый, чанки нарезаны плохо, reranking настроен слабо, а в промпте нет требований «не выдумывать за пределами контекста», модель все равно может додумывать.

Хороший RAG — это не просто векторная база. Это целая дисциплина: подготовка документов, индексация, поиск, reranking, контроль источников, тестирование.

Ошибка №3. Дообучать на сырых, противоречивых примерах

Fine-tuning усиливает паттерны. И хорошие, и плохие. Если датасет шумный, противоречивый, криво размеченный или стилистически неоднородный, модель закрепит именно этот хаос.

Иногда команда тратит бюджет на fine-tuning, а потом удивляется, почему ответы стали не стабильнее, а страннее. Причина почти всегда в качестве обучающих примеров.

Ошибка №4. Игнорировать экономику решения

В прототипе все выглядит красиво. Но потом приходят вопросы взрослой эксплуатации: сколько стоит inference, как обновлять знания, кто поддерживает датасет, как тестировать качество, как катить новые версии, как контролировать деградацию.

RAG и fine-tuning — это не только вопрос качества, но и вопрос операционной модели. Что вы сможете поддерживать через полгода без героизма всей команды?

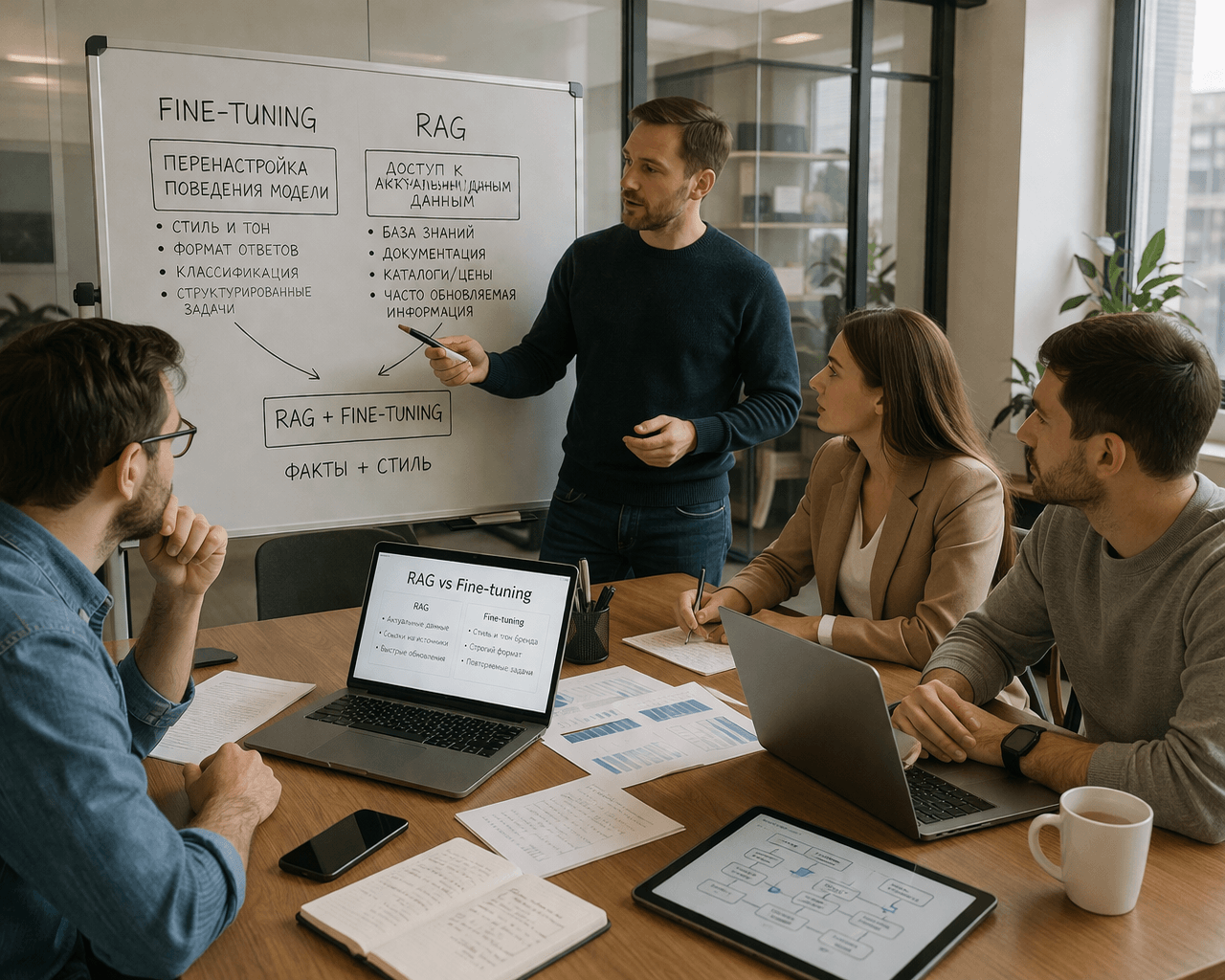

Когда лучший выбор — связка RAG + Fine-tuning

Самые сильные production-системы часто не выбирают между подходами, а соединяют их.

И это логично.

RAG отвечает за доступ к актуальным знаниям. Fine-tuning — за устойчивое поведение модели поверх этих знаний. Один приносит факты, второй — форму.

Как выглядит такая связка на практике

Представим B2B-платформу с большим объемом документации и поддержкой клиентов.

Система получает вопрос пользователя.

Сначала retrieval-модуль находит нужные статьи, changelog, политики и внутренние заметки.

Потом модель, уже дообученная на хорошем наборе примеров, выдает ответ в корпоративном стиле: без лишней воды, с четкой структурой, с дисклеймерами там, где это нужно, и с эскалацией в человека в сложных случаях.

В итоге бизнес получает сразу два преимущества:

- ответ опирается на свежие данные;

- ответ оформлен так, как требуется компании.

Это и есть зрелый вариант архитектуры, в котором не приходится жертвовать ни актуальностью, ни качеством подачи.

Мини-кейс

AI-ассистент для хостинг-провайдера отвечает клиентам по настройке VPS, сетям, панелям управления, резервному копированию и базовым вопросам безопасности. База знаний у провайдера регулярно обновляется — значит, без RAG не обойтись.

Но компания также хочет, чтобы ответы были собранными: сначала короткий вывод, затем пошаговая инструкция, затем блок «проверьте перед применением», а в чувствительных вопросах — мягкая рекомендация сделать бэкап. Вот это уже зона fine-tuning.

По отдельности каждый подход даст только часть результата. Вместе — рабочий инструмент, который не рассыпается в реальном использовании.

Как понять, что выбрать: практический чек-лист

Чтобы не спорить абстрактно, достаточно задать себе несколько прямых вопросов.

Вопрос 1. Знания часто меняются?

Если да, начинайте с RAG.

Все, что живет в документах, базах, каталогах, changelog и регламентах, почти всегда лучше вытаскивать из индекса, а не вшивать в модель.

Вопрос 2. Нужен единый формат или стиль?

Если да, смотрите в сторону fine-tuning.

Когда ценность — в стабильно правильной подаче, фиксированной структуре, tone of voice и предсказуемом поведении, дообучение становится сильным кандидатом.

Вопрос 3. Нужны ссылки на источник и проверяемость?

Если да, опора на retrieval почти обязательна.

В B2B, поддержке, compliance и внутренней автоматизации доверие строится не на красоте текста, а на том, можно ли проверить основания ответа.

Вопрос 4. Запросы однотипные?

Если да, fine-tuning может дать сильный прирост.

Повторяемость — лучший друг дообучения. Чем стабильнее паттерн входа и желаемого выхода, тем выше шанс, что обучение окупится.

Вопрос 5. У вас вообще есть качественный датасет?

Вот вопрос, который отрезвляет многие амбиции.

Если для fine-tuning нет хороших примеров, размеченных единообразно и в достаточном объеме, лучше не начинать с дообучения только потому, что это звучит «серьезнее». Иногда один хороший RAG-прототип приносит в бизнес больше пользы, чем месяцы подготовки слабого датасета.

С чего начать, если вы строите систему сейчас

На старте лучше не пытаться победить всю сложность мира за один спринт.

Самый разумный путь обычно выглядит так:

Шаг 1. Соберите базовый RAG

Подключите ограниченный набор качественных источников. Не все подряд, а те, на которые действительно должен опираться будущий ассистент.

Шаг 2. Настройте retrieval

Проверьте, насколько хорошо система вообще находит нужные фрагменты. Много ошибок в AI-продуктах рождается не в генерации, а на этапе поиска. Если модель получает плохой контекст, она не спасет ситуацию одной только «интеллектуальностью».

Шаг 3. Зафиксируйте формат ответов промптом

Часто этого хватает, чтобы проверить гипотезу и понять, нужен ли fine-tuning вообще.

Шаг 4. Смотрите на реальные провалы

Если вы видите, что модель знает факты, но все равно отвечает вразнобой, нарушает формат, гуляет по тону или нестабильно обрабатывает повторяющиеся кейсы — вот тогда появляется предметный аргумент в пользу fine-tuning.

Шаг 5. Дообучайте не ради моды, а ради измеримого эффекта

Например: поднять точность классификации с 82% до 93%, сократить среднюю длину ответа, повысить соблюдение шаблона, уменьшить долю ручных правок редактора, улучшить first-response resolution в поддержке.

Когда цель измерима, архитектура перестает быть религией и становится инженерией.

Инфраструктура тоже имеет значение

Есть еще один практический слой, о котором любят вспоминать слишком поздно: где все это будет жить и на каком железе работать.

RAG предъявляет требования к хранилищам, поиску, индексации, пайплайну обновления данных, latency и политике доступа. Fine-tuning — к подготовке датасета, GPU-ресурсам, циклам обучения, валидации и развертыванию новых версий модели.

Иными словами, спор «RAG или fine-tuning» — это еще и вопрос инфраструктурной зрелости. Иногда команда выбирает не идеальный, а поддерживаемый путь. И это не слабость, а здравый расчет.

Если у компании уже есть аккуратная база знаний, понятный поток обновлений и задача отвечать по документам, запуск RAG-платформы может быть самым рациональным первым шагом. Если же бизнес упирается в нестабильный формат, брендовый стиль и повторяемые операции, возможно, выгоднее инвестировать в качественный датасет и controlled fine-tuning.

Главное — не строить космический корабль там, где нужен надежный грузовик.

Вывод

Fine-tuning и RAG не стоит сталкивать лбами. Они созданы для разных задач.

RAG нужен там, где модель должна опираться на актуальные внешние данные: документы, каталоги, инструкции, changelog, базы знаний. Это выбор в пользу свежести, проверяемости и гибкости.

Fine-tuning нужен там, где важно устойчивое поведение: стиль, формат, классификация, дисциплина ответа, работа по повторяемому сценарию. Это выбор в пользу стабильности и управляемости.

А если задача взрослая и боевая, чаще всего побеждает комбинация:

RAG приносит факты, fine-tuning задает характер.

Именно поэтому правильный вопрос звучит не «что лучше?», а «что именно должна улучшить система в нашем случае?». Когда ответ на этот вопрос найден, архитектура перестает быть спором на уровне терминов и превращается в рабочее решение.

Рынок AI сейчас шумный, и соблазн выбрать самый громкий путь велик. Но сильные системы почти всегда строятся спокойнее: от задачи, от данных, от экономики и от реальных сценариев использования. Если идти так, без лишнего блеска и самообмана, результат обычно оказывается крепче. А это в технологиях ценится дольше любой моды.