Оглавление

Введение

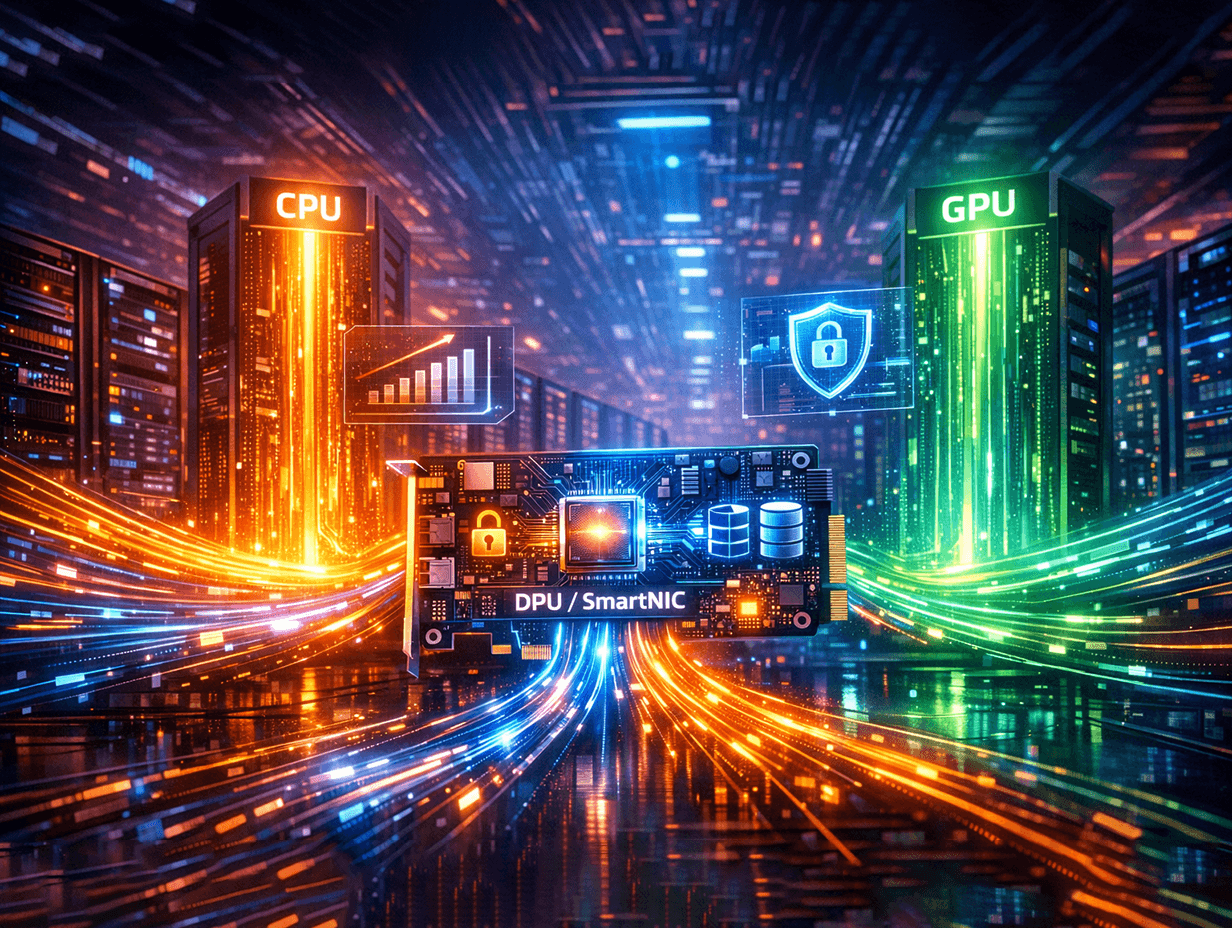

Бурный рост искусственного интеллекта бросает новые вызовы дата-центрам. Модели становятся больше, данные текут рекой, а требования к вычислениям растут экспоненциально – значит, инфраструктуре нужно справляться с небывалыми нагрузками. Оказалось, что ускорение AI-инфраструктуры зависит не только от множества CPU и мощных GPU, но и от появления новых героев – специализированных сетевых ускорителей DPU и SmartNIC. Для системных архитекторов и ИТ-директоров эти технологии уже перестают быть экзотикой и превращаются в секретное оружие современных AI-кластеров. В этой статье простым языком объясняется, что такое DPU и SmartNIC, почему DPU в дата-центрах теперь на слуху, и как SmartNIC и AI-нагрузки работают вместе, чтобы вывести производительность, безопасность и масштабируемость на новый уровень.

Что такое DPU и SmartNIC простыми словами

DPU (Data Processing Unit) – «процессор обработки данных», новый тип программируемого процессора, заточенный под движение и обработку данных. Проще говоря, DPU – это мини-сервер на карте расширения, оптимизированный для сетевых, инфраструктурных и_storage_ задач. Он обычно содержит многоядерный процессор (часто архитектуры ARM), высокоскоростной сетевой интерфейс и набор аппаратных ускорителей. DPU берёт на себя такие роли, как обработка сетевого трафика, шифрование, управление хранением данных и другие вспомогательные функции, освобождая центральный CPU для основных вычислений. Фактически, DPU выступает третьим столпом вычислительной техники наряду с CPU и GPU. Как образно заметил глава NVIDIA, «CPU – для общих задач, GPU – для параллельных вычислений, а DPU – чтобы безопасно перемещать данные по инфраструктуре». То есть, если CPU – это мозг сервера, а GPU – мускулы для интенсивных вычислений, то DPU можно назвать “системой кровообращения” дата-центра, которая гоняет данные с максимальной эффективностью.

SmartNIC (Smart Network Interface Card) – «умная сетевая карта», близкий родственник DPU. Изначально сетевые интерфейсные карты (NIC) просто передавали пакеты данных, но специализированные сетевые ускорители нового поколения превращают их в мини-компьютеры. SmartNIC – это программируемая NIC, способная самостоятельно выполнять ряд задач: виртуализацию сети, шифрование/дешифрование трафика, обработку запросов к хранилищу и др.. По сути, SmartNIC разгружает часть работы процессора, беря на себя обслуживание сети и хранилища, что улучшает общую пропускную способность и снижает нагрузку на CPU. Важно понимать, что DPU vs SmartNIC – это скорее степень возможностей: DPU обычно включает полноценный встроенный CPU и ОС, множество ускорителей и может выполнять более широкий спектр задач, тогда как SmartNIC может ограничиваться несколькими фиксированными функциями. Как метко отметил один эксперт, не каждая SmartNIC тянет на звание DPU, но каждый настоящий DPU по сути встроен в SmartNIC-плату.

Сравнение с CPU и GPU. Центральный процессор (CPU) – универсальный солдат, способный на всё понемногу, но его мощность уходит и на основные вычисления, и на рутину обслуживания системы. Графический процессор (GPU) – узкий специалист по параллельным вычислениям, незаменимый для обучения нейросетей и обработки больших массивов данных. DPU же отличается тем, что сочетает программируемые ядра, аппаратные ускорители и скоростной сетевой конвейер для обработки данных. CPU выполняет задачи последовательно, GPU – массово параллельно, а DPU берёт на себя всё, что связано с перемещением и подготовкой данных. В эволюции серверов CPU появился первым, затем пришёл GPU, а теперь к ним присоединился DPU для современных нагрузок, ориентированных на данные. Более того, DPU способен работать в тандеме с CPU/GPU: например, GPU обрабатывает вычисления, а DPU обеспечивает подачу данных и обслуживание сети, благодаря чему CPU и GPU не тратят время на постороннюю работу и могут «летать» на полную мощность.

Зачем AI-инфраструктуре нужны эти ускорители

Современные центры обработки данных всё чаще включают DPU/SmartNIC в свой арсенал – особенно там, где речь про искусственный интеллект и машинное обучение. DPU в дата-центрах завоёвывают популярность, потому что их широко используют для ускорения AI/ML-задач, снимая нагрузку с центральных (CPU) и графических (GPU) процессоров при выполнении операций обучения моделей и инференса (вывода). Грубо говоря, DPU берёт на себя всю “черновую” работу по движению данных, позволяя основным процессорам сосредоточиться на интеллекте. Это критично в AI-системах: нейросети и глубокое обучение требуют обработки колоссальных массивов данных, быстрой коммуникации между десятками или сотнями узлов и беспрерывной подачи данных к GPU. Без DPU/SmartNIC ценные ресурсы CPU тратятся на прокачку пакетов, шифрование, перегон данных из хранилища – вместо того чтобы считать модели. В итоге замедляется всё: GPU простаивают в ожидании данных, время обучения растёт, а масштабирование системы упирается в узкие места передачи данных.

Специализированные ускорители решают эту проблему. Они разгружают обработку сетевого трафика, оптимизацию хранения и функции безопасности с CPU/GPU, устраняя “бутылочные горлышки” и повышая общую производительность системы, особенно в крупных AI-развёртываниях. Как отмечается в одном обзоре, DPUs стали ключевым элементом новых гипермасштабных дата-центров наряду с CPU и GPU. Например, NVIDIA прямо называет DPU третьим пилоном вычислений в эпоху облаков и ИИ. Это подтверждается практикой крупных облачных провайдеров: AWS, Microsoft и Google уже активно применяют SmartNIC и DPU в AI-инфраструктуре. AWS разработала семейство Nitro – свои аппаратные DPUs, которые отдают на них задачи хранения, сети и безопасности, изолируя при этом пользовательские виртуальные машины от основной системы. Microsoft в Azure устанавливает собственные SmartNIC (в том числе FPGA-решения) для ускорения программно-определяемых сетей (SDN) и обработки хранилищ. Google совместно с Intel внедряет IPU (Infrastructure Processing Unit – по сути, DPU) для обеспечения высокой плотности виртуальных сетей и разгрузки сервера. Проще говоря, даже гиганты с неограниченными CPU-ресурсами увидели необходимость в DPU, чтобы масштабировать AI-сервисы без потери эффективности.

Кроме производительности, важную роль играет безопасность AI-инфраструктуры и изоляция нагрузок. DPU и SmartNIC позволяют реализовать концепцию «zero trust» прямо на уровне сети: они могут изолировать трафик разных приложений и клиентов, шифровать данные на лету, фильтровать пакеты – и всё это без участия основного CPU. В эпоху, когда AI-сервисы часто работают в облаке и обрабатывают ценные данные, такая аппаратная безопасность крайне востребована. Изоляция трафика на уровне SmartNIC означает, что даже если одно приложение скомпрометировано, его сетевые потоки не смогут повлиять на соседа – DPU ограждает их друг от друга в самом «привходе» сервера. Для многопользовательских AI-платформ это шанс обеспечить безопасность и качество сервиса без колоссальных затрат производительности на программные брандмауэры.

Наконец, не забудем о стоимости и эффективности. DPU меняют экономику дата-центров. Перекладывая инфраструктурные задачи на специализированное железо, операторы добиваются лучшего использования серверов. Одно из исследований показало, что внедрение DPU способно на 30% снизить энергопотребление на охлаждение и сократить число необходимых серверов – при одновременном росте производительности (за счёт консолидации рабочих нагрузок). Освобождённые CPU-ядра можно пустить на полезные вычисления, или обслуживать больше клиентов на том же оборудовании. В условиях, когда AI-тренировки потребляют мегаватты, такая оптимизация — весомый аргумент. Неудивительно, что DPU называют драйвером “переделки” архитектуры дата-центров и одним из ключевых факторов снижения TCO (общей стоимости владения) в облачных инфраструктурах.

Основные сценарии применения DPU/SmartNIC

Рассмотрим несколько конкретных примеров, как специализированные сетевые ускорители используются на практике в контексте AI и высоконагруженных систем.

Распределённые вычисления и масштабируемый AI

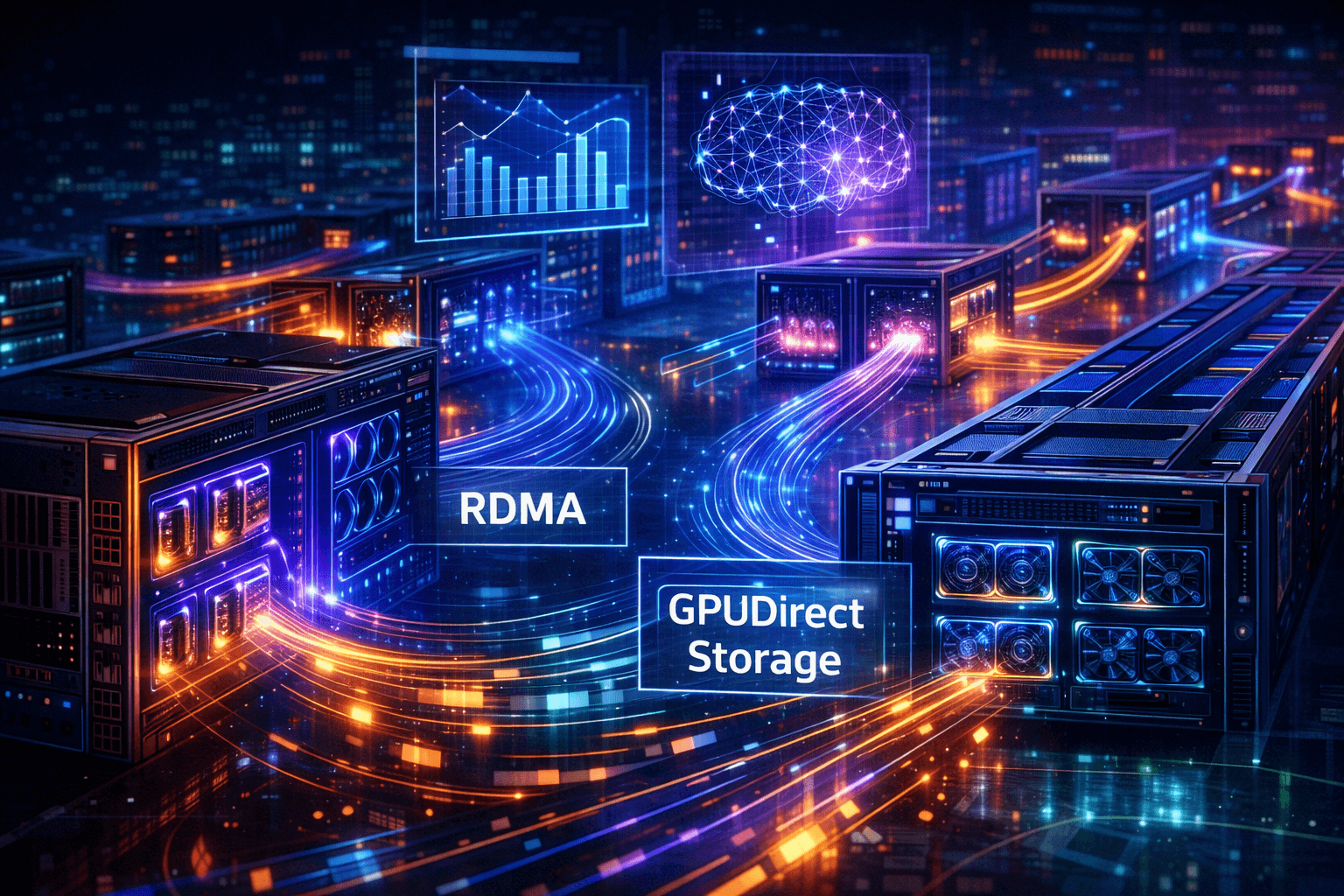

Для обучения больших моделей AI часто используется кластер из множества серверов с GPU – так называемые распределённые вычисления. В таких HPC- и AI-кластерах узкие места возникают на уровне сети: гигабайты градиентов и данных должны обмениваться между GPU разных узлов каждую секунду. DPU и SmartNIC здесь выступают как ускорители межузлового обмена. Они поддерживают технологии типа RDMA (Remote Direct Memory Access) over Converged Ethernet и InfiniBand, которые позволяют пересылать данные между серверами с минимальной задержкой, обходя лишнюю обработку на CPU. Например, аппаратная поддержка RDMA в DPU сокращает задержки при распределённом обучении моделей, а это напрямую ускоряет сходимость нейросети.

Другой пример – технология NVIDIA GPUDirect Storage: с помощью DPU GPU могут напрямую читать данные с NVMe-накопителей по сети, минуя CPU. GPU получает нужные данные “напрямую из хранилища” через умную сетевую карту, не теряя время на копирование через оперативную память сервера. В результате великие и прожорливые модели быстрее загружают обучающие выборки, а дорогие GPU меньше простаивают в ожидании. В совокупности, при больших масштабах (например, в кластерных тренировках на сотнях GPU) такие оптимизации дают существенный прирост производительности и эффективности: ускоряется каждое взаимодействие, от ввода данных до синхронизации градиентов. По оценкам экспертов, DPUs могут улучшить утилизацию GPU в AI-тренингах, устраняя время простоя – GPU больше времени тратят на вычисление, а не на ожидание данных.

Изоляция трафика и безопасность инфраструктуры

Современные AI-сервисы работают в окружении микросервисов, множества контейнеров и виртуальных машин, часто – в облаке совместно с другими клиентами. Безопасность AI-инфраструктуры и изоляция трафика между такими компонентами – первостепенная задача. DPU и SmartNIC предоставляют аппаратные средства для её решения. Во-первых, многие DPU оснащены встроенными крипто-движками, способными шифровать/дешифровать трафик на линии в реальном времени без нагрузки на CPU. Например, при передаче данных между сервисами или при выводе результатов AI-модели клиенту, SmartNIC может шифровать каждое сообщение “на лету” – это гарантирует безопасность, не уменьшая пропускную способность.

Во-вторых, DPU позволяют реализовать изоляцию сети на уровне железа. Технологии виртуализации ввода-вывода (SR-IOV, VirtIO) в сочетании с программируемым datapath в DPU значат, что трафик разных виртуальных машин или контейнеров разделяется уже на сетевой карте, и ни один пакет не пройдет мимо назначенного канала. По сути, SmartNIC выступает «вратарём» на сетевом порте: она проверяет, имеет ли данный пакет право пройти к ресурсу, от кого он и куда, соответствует ли политикам безопасности. Если CPU – это охранник данных, то DPU – это металлоискатель и турникет при входе.

Практический пример – внутренние облачные сети с нулевым доверием: каждое приложение общается через зашифрованные каналы, а DPU на лету проверяет и ограничивает эти соединения по заданным правилам. NVIDIA BlueField DPU, к примеру, поддерживает концепцию “безопасной изоляции” и может запускать агенты безопасности (брандмауэры, системы обнаружения вторжений) прямо на NIC, изолированно от хоста. В результате, даже если злоумышленник получит доступ к серверу, DPU обеспечивает дополнительный уровень защиты, контролируя трафик и не позволяя атаке распространиться по сети. Для AI-систем, обрабатывающих конфиденциальные данные (медицина, финансы) или работающих в публичном облаке, такие возможности значительно повышают уровень доверия к инфраструктуре.

Готовы перейти на современную серверную инфраструктуру?

В King Servers мы предлагаем серверы как на AMD EPYC, так и на Intel Xeon, с гибкими конфигурациями под любые задачи — от виртуализации и веб-хостинга до S3-хранилищ и кластеров хранения данных.

- S3-совместимое хранилище для резервных копий

- Панель управления, API, масштабируемость

- Поддержку 24/7 и помощь в выборе конфигурации

Результат регистрации

...

Создайте аккаунт

Быстрая регистрация для доступа к инфраструктуре

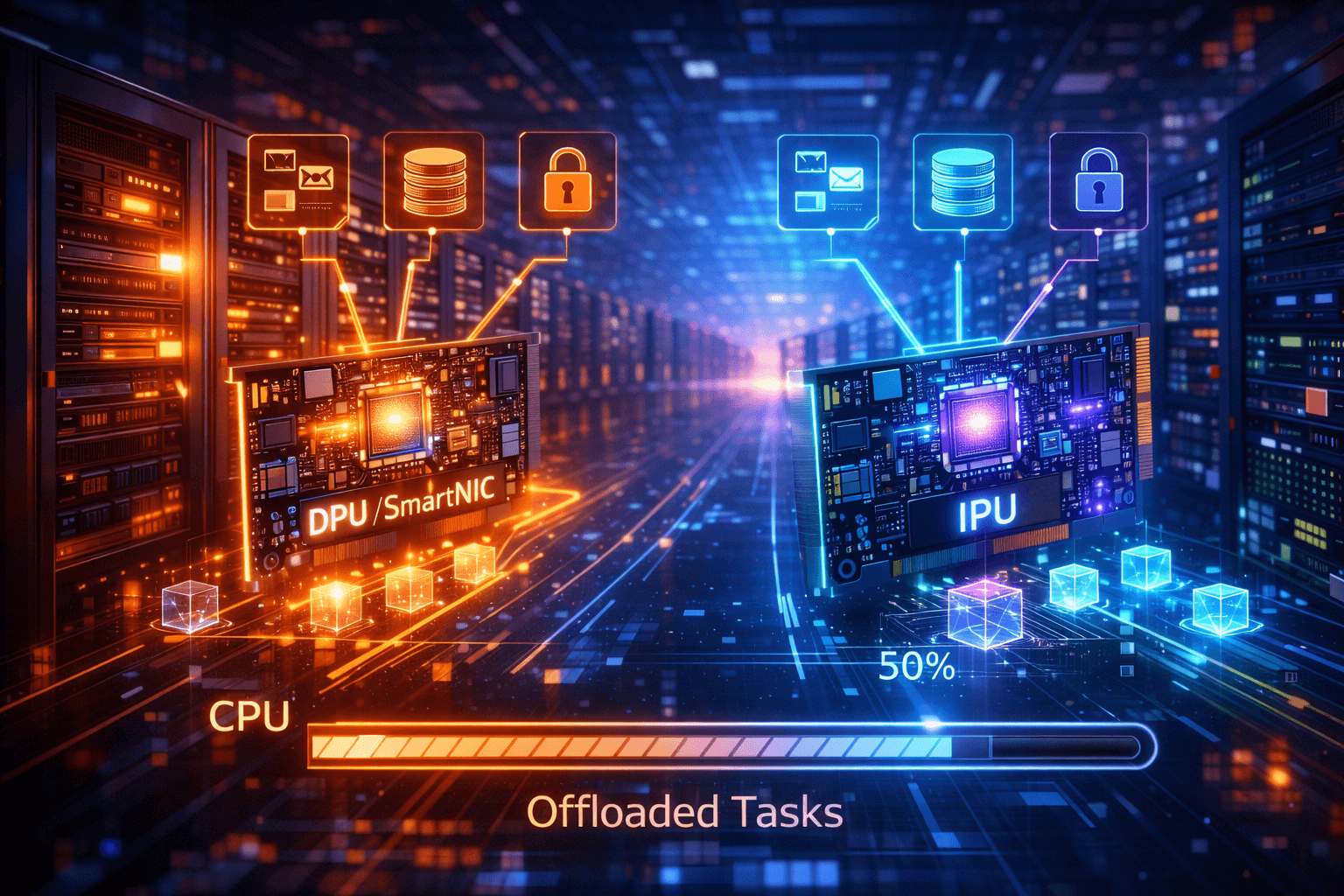

Разгрузка CPU и освобождение ресурсов

Одно из ключевых назначений DPU/SmartNIC – разгрузка CPU от сервисных задач. В контексте AI-инфраструктуры это особенно ценно: CPU-ядра нужны для подготовки данных, запуска приложений, координации GPU, и т.д., и нежелательно тратить их на второстепенные функции. SmartNIC берёт на себя сетевые и инфраструктурные сервисы, тем самым высвобождая десятки процентов вычислительной мощности CPU. По оценкам Intel, в типичном дата-центре до 30% циклов CPU уходит на обработку сети, хранения, шифрование и других фоновых задач. Перенос этих задач на IPU/DPU автоматически возвращает эти проценты в распоряжение ваших приложений.

Примеры разгрузки CPU на практике: виртуальные коммутаторы (vSwitch) и обработка сетевых накладных протоколов (виртуальные сети VXLAN/Geneve). В гипервизорах и облачных платформах каждое поступление пакета может требовать участия программного коммутатора на CPU – что при больших нагрузках отнимает значительную долю ресурсов. DPU же может реализовать виртуальный коммутатор прямо в аппаратном ускорителе, перенаправляя трафик между виртуальными машинами без единого такта основного CPU. Компания Marvell, например, в своих OCTEON DPU указывает возможность аппаратного offload’а Open vSwitch (OVS) и туннелирования, за счёт чего облачные провайдеры типа Oracle смогли предложить кастомные изолированные сети без потери производительности. Oracle напрямую отмечает: «перенеся эти функции с CPU на DPU, мы улучшили TCO и смогли предложить клиентам виртуальные облачные сети с лучшей производительностью и безопасностью».

Другой пример – хранение данных и NVMe-oF (NVMe over Fabrics). Вместо того, чтобы CPU обрабатывал сетевые запросы к блочным хранилищам (NAS/SAN), DPU может выступать контроллером хранения. Intel IPU E2000 (Mount Evans), разработанный совместно с Google, позволяет гиперскейлерам вынести функции хранения и виртуализации ввода-вывода в отдельный чип, тем самым почти полностью освободив CPU узлов от этих накладных расходов. В итоге каждый сервер тратит почти все свои x86-ядра только на приложения/модели, а IPU занимается “домашней работой” – управлением сетевыми подключениями, доступом к дискам, репликацией данных, и т.п. В сумме CSP (поставщики облачных услуг) получают больше полезной мощности с тех же серверов и сокращают общие затраты.

Для AI-инфраструктуры это значит, что больше потоков данных, подготовка batch-ей, загрузка моделей – всё это идёт параллельно и не “подъедает” CPU циклы. DPU разгружает и координирует такие сервисы, как: - Сеть и трафик: обработка пакетов, балансировка нагрузки, управление соединениями; - Хранилище: агрегирование запросов к дискам, кэширование, RAID/кодирование для надёжности; - Сервисные агенты: телеметрия, логирование, управление контейнерами, которые можно выносить на DPU.

Совокупный эффект – рост плотности вычислительных задач на сервер (больше AI-задач на одном узле) и снижение накладных затрат на масштабирование кластера.

Ускорение хранения данных и работа с базами

AI-проекты неразрывно связаны с большими данными. Обучение моделей требует быстрых потоков данных из хранилищ, а инференс (например, в рекомендательных системах) часто упирается в скорость доступа к базе или файлам. DPU и SmartNIC помогают “подтянуть” подсистему хранения до скорости остальной инфраструктуры. Помимо упомянутого GPUDirect Storage, есть и другие аспекты: - Аппаратное ускорение NVMe-oF: Современные DPU (например, NVIDIA BlueField-3) имеют встроенные модули для ускорения протоколов NVMe/TCP и RDMA. Это означает, что DPU может обслуживать удалённые дисковые запросы со скоростью, близкой к локальному SSD, полностью освобождая CPU от обработки сетевых прерываний и TCP/IP стека. Большие распределённые хранилища для AI (например, хранилище изображений или характеристик для ML) выигрывают в пропускной способности и задержках. - Сжатие и обработка данных на лету: Специальные движки на DPU способны выполнять сжатие, дедупликацию и проверку целостности данных в потоке. В AI это применимо, например, при передаче больших массивов признаков или параметров моделей между узлами – DPU может сразу паковать их и распаковывать, экономя драгоценную пропускную способность сети без вовлечения CPU. - Кэширование и предобработка: Поскольку DPU – по сути маленький компьютер на границе сети, на нём можно запускать сервисы, связанные с данными. Например, предварительная выборка данных (prefetch) из медленного хранилища на локальные SSD в узле: DPU может следить за паттерном доступа и заранее подтягивать нужные куски данных ближе к вычислителям. Или же выполнять первичную фильтрацию/агрегацию данных, чтобы GPU/CPU получили уже “очищенный” поток.

Всё это особенно важно для распределённых баз данных и дата-лейков, обслуживающих AI. Практически мы подходим к концепции Data Processing on NIC – когда часть функций системы хранения и баз данных выполнена прямо на сетевой карте. Такой подход уменьшает задержки и разгружает магистральную сеть, ведь лишние данные отфильтровываются или сжимаются на самом “входе” в сервер.

Популярные решения DPU и SmartNIC: NVIDIA, Intel, Marvell

Рынок специализированных ускорителей развивается бурно, и уже есть несколько зрелых решений, на которые стоит обратить внимание.

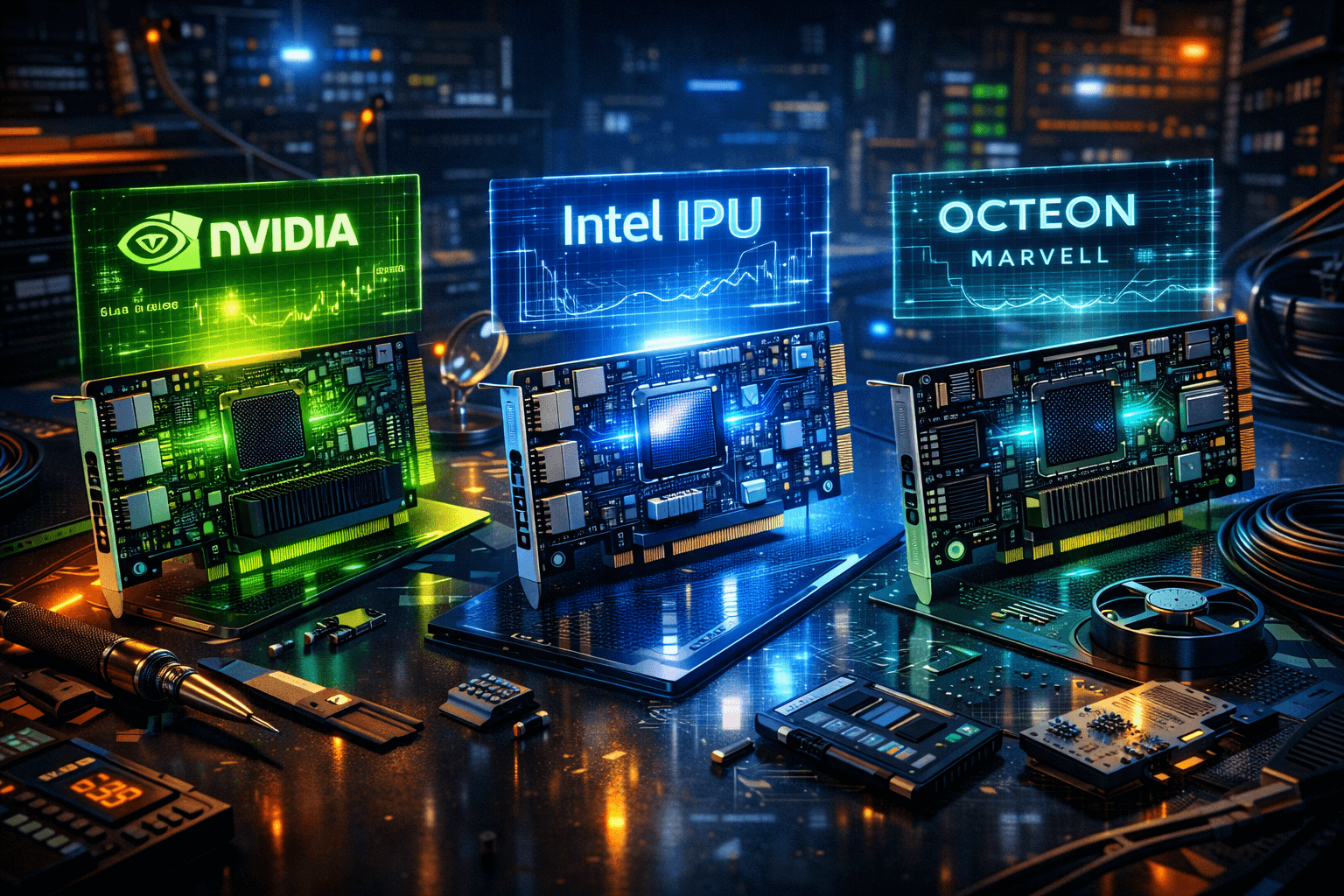

NVIDIA BlueField

NVIDIA BlueField – одно из самых известных семейств DPU, выросшее из линейки Mellanox (после поглощения Mellanox в 2020 году). Актуальные модели (BlueField-2, BlueField-3) представляют собой мощные SoC с ядрами ARM, 100–400 Гбит/с сетевыми интерфейсами и специализированными ускорителями для сетевых, AI- и безопасностных функций. BlueField позиционируется как универсальная платформа: она может работать и как SmartNIC, и как самостоятельный “мини-сервер”. Например, BlueField DPU поддерживает платформу NVIDIA DOCA – набор библиотек для разработки приложений, использующих DPU (от виртуализации сетей до DPI-фильтрации). В контексте AI BlueField применяется для ускорения межсоединений Ethernet в больших GPU-кластерах (инициатива NVIDIA Spectrum-X опирается на связку коммутаторов Spectrum-4 и DPU BlueField-3 для построения специализированных Ethernet-сетей для ИИ). Кроме того, BlueField интегрирует механизм GPUDirect Storage и может служить контроллером NVMe-oF хранилищ прямо на узлах. Одним из рекордных кейсов было использование BlueField DPU для инференса нейросетей: сняв нагрузку с CPU, удалось обслужить значительно больше запросов к AI-модели на одном сервере, чем без DPU. Вдобавок, BlueField предлагает аппаратную изоляцию и безопасность – вплоть до того, что на DPU можно выносить всю плоскость управления сервера (hypervisor, agent) и добиться архитектуры “доверенный DPU + недоверенный хост”, что интересно для облаков и периферийных вычислений (concept “secure enclave” на базе DPU).

Intel IPU

Intel продвигает свою линию Infrastructure Processing Unit (IPU) – это аналог DPU с упором на нужды облачных провайдеров. В отличие от NVIDIA, Intel предлагает как FPGA-ориентированные IPU, так и ASIC-решения. Из ярких представителей – Intel IPU E2100 (Mount Evans), разработанный совместно с Google. IPU Intel сосредоточены на отделении инфраструктурных задач от вычислительных в облаке. Как описано в корпоративном блоге Intel, «IPU перехватывает фоновые задачи, освобождая CPU для пользовательских приложений; больше свободных ядер – больше потенциальной выручки». IPU обеспечивают изоляцию «подсовывая» между хост-CPU и устройствами слой, управляемый самим провайдером облака. Например, IPU может полностью контролировать загрузку сервера, доступ к сеть/диску, а гипервизор на хосте работает минимально – это улучшает безопасность, так как арендатор не может обойти или взломать то, к чему у него нет доступа (всё контролирует IPU). С точки зрения AI, Intel IPU полезны тем, что позволяют эффективнее масштабировать инфраструктуру под множество одновременных машин обучения (multi-tenant AI cloud): изолируя трафик, гарантируя QoS и снижая накладные расходы, провайдер может разместить больше AI-задач на одном “куске железа” безопасно. Intel хвастается, что 6 из 8 крупнейших облачных компаний уже внедряют их IPU – это косвенно показывает, что технология оправдывает себя в масштабах гиперскейла. Для корпоративных заказчиков Intel готовит более массовые продукты IPU, ожидаемые в 2024 году, что означает: вероятно, скоро появятся готовые серверы с IPU для любого бизнеса, собирающего собственную AI-инфраструктуру.

Marvell OCTEON

Marvell – пионер в области сетевых процессоров, фактически один из родоначальников концепции SmartNIC/DPU. Ещё в 2005 году Marvell (тогда Cavium) выпустила первую OCTEON – многоядерный сетевой процессор для обработки пакетов. Сегодняшние решения – Marvell OCTEON 10 DPU и SmartNIC LiquidIO – продолжают эту линию, будучи востребованы как в облаках, так и в телеком-отрасли. OCTEON DPU обладают до нескольких десятков ядер ARM (например, TX2 имеет 36 ядер), многопортовые сетевые интерфейсы (вплоть до 5×100 Гбит/с) и специализированные блоки ускорения для криптографии, трафика, виртуализации и хранения. Особый акцент Marvell делает на оптимизации под масштаб: их DPU славятся выгодой по стоимости и энергии при массовом развёртывании (не зря Marvell хвалится отправкой миллионного SmartNIC на OCTEON уже в 2020 году). В контексте AI и облаков Marvell OCTEON применяется для таких задач, как: - Акселерация виртуальных сетей и накладных протоколов (NVMe-oF, VXLAN) – например, LiquidIO SmartNIC разгружает виртуальный сетевой стек Oracle Cloud, позволяя внедрять продвинутые сетевые функции (виртуальные фаерволы, изолированные сети) без удорожания сервера. - Безопасность и DPI: благодаря аппаратному ускорению IPsec/TLS и фильтрации пакетов, DPU на базе OCTEON могут на лету шифровать трафик, проводить глубокий анализ пакетов (например, для обнаружения атак или фильтрации контента) на скоростях линейного порта. - 5G и edge-AI: Marvell продвигает OCTEON и в телеком, и на периферию, что пересекается с AI на “краю” – например, обработка видеопотоков, инференс на базовых станциях. Способность OCTEON выполнять базовые AI-алгоритмы совместно с обработкой трафика делает его привлекательным для сценариев, где нужно чуть-чуть AI в каждом сетевом устройстве (например, умный роутер с ML-анализом трафика).

Marvell также активно сотрудничает с производителями оборудования, позволяя интегрировать свои DPU с пользовательскими IP-блоками (ASIC-со-дизайн). Таким образом, если ваша AI-задача специфична (скажем, требует особой обработки данных на входе), есть опции кастомизации SmartNIC под себя.

Преимущества внедрения DPU/SmartNIC в AI-инфраструктуре

Внедрение DPU и SmartNIC даёт целый спектр ощутимых выгод для современных дата-центров, особенно заточенных под AI-нагрузки:

- Рост производительности и эффективность. Освобождая CPU от лишней работы и ускоряя обработку данных “на месте”, DPU повышают пропускную способность системы. AI-модели обучаются быстрее (GPU не простаивают без данных), инференс выполняется с меньшими задержками, и в целом инфраструктура может обработать больше задач за единицу времени. В ряде случаев зафиксирован прирост производительности AI-сервисов в разы – за счёт того, что сеть и I/O перестают быть ограничивающим фактором.

- Изоляция трафика и стабильность. Специализированные ускорители позволяют изолировать сетевые потоки разных приложений и клиентов на аппаратном уровне. Это значит, что «шумные соседи» больше не помеха: бурный трафик одной AI-задачи не вызовет задержек у другой. Изоляция трафика улучшает предсказуемость производительности и позволяет безопасно запускать разные нагрузки на общей инфраструктуре. Для многопользовательских AI-платформ или SaaS-сервисов на базе ML это критично – клиенты не влияют друг на друга, и каждый получает гарантированные ресурсы сети и хранения.

- Повышение безопасности. DPU и SmartNIC усиливают безопасность на нескольких уровнях. Они способны шифровать данные “на лету” без потери скорости, что защищает чувствительную информацию в AI-процессах (например, персональные данные пользователей, проходящие через модель). Также DPU реализуют Zero Trust принцип: каждый пакет проверяется, нет ли нарушений политик, а подозрительный трафик можно отсеять до того, как он достигнет CPU. Изоляция инфраструктурных функций (вплоть до вынесения гипервизора на DPU, как в проектах NVIDIA Morpheus или VMware Monterey) не позволяет атакующему получить контроль над системой даже при компрометации хоста. В итоге AI-инфраструктура становится более защищённой от сетевых атак, утечек и вредоносного кода.

- Снижение задержек. Для AI-решений, особенно realtime-сервисов (например, системы рекомендаций, аналитика потоков с камер, трейдинг на основе ML), задержка – враг №1. DPU уменьшают задержки на всех этапах: быстрее доставляют данные GPU (через RDMA, GPUDirect), минимизируют переходы в ядро ОС на сетевых операциях, ускоряют доступ к хранилищам. Даже несколько миллисекунд выигрыша могут существенно улучшить отклик системы. В распределённом обучении снижение латентности коммуникаций ускоряет каждую итерацию алгоритма, экономя часы и дни обучения модели. Кроме того, аппаратные очереди и offload TCP/IP на SmartNIC устраняют вариативность задержек (jitter), что важно для стабильности обучения и инференса.

- Лучшая масштабируемость и TCO. Хотя напрямую не указано в требованиях, стоит отметить: DPU/SmartNIC улучшают экономику масштабирования. С их помощью уделяется меньше CPU на инфраструктурные задачи, значит, больше ядер идут в дело, или можно ставить меньше узлов для той же нагрузки. Энергоэффективность дата-центра растёт – специализированные чипы выполняют работу быстрее и с меньшим энергопотреблением, чем универсальные CPU, у которых уходит 100 инструкций на то, что DPU делает за 5. В цифрах это выражается, например, в 25–30% экономии энергозатрат при максимальной нагрузке. Также, разгружая CPU, компании могут дольше использовать существующие серверы, откладывать покупки новых – получая больше полезной работы на доллар инвестиций. Все эти косвенные выгоды приводят к снижению общего бюджета инфраструктуры, что для ИТ-директоров зачастую не менее важно, чем технические показатели.

Заключение

AI-инфраструктура будущего немыслима без специализированных ускорителей. DPU и SmartNIC уже сегодня превращаются в равноправных “граждан” дата-центра наряду с привычными CPU и GPU. Они не заменяют собой универсальные и графические процессоры, но делают их работу эффективнее, взяв на себя критически важную третью функцию – движение и подготовку данных. Для системных архитекторов это означает появление новых инструментов в проектировании: можно смелее масштабировать AI-сервисы, не боясь, что сеть или хранение «задушат» вашу прекрасную модель. Для специалистов по инфраструктуре – это шанс внедрить ускорение AI-инфраструктуры и обеспечить её безопасность на аппаратном уровне там, где раньше приходилось мириться с компромиссами.

Энергичное развитие DPU/SmartNIC-технологий продолжится. Крупнейшие игроки (NVIDIA, Intel, Marvell, AMD и др.) инвестируют миллиарды в эту область, и в ближайшие годы мы увидим ещё более мощные и умные решения. Возможно, появятся стандартные платформы “сервер на NIC”, полностью избавляющие CPU от вспомогательных функций. Одно ясно уже сейчас: специализированные сетевые ускорители превращают дата-центр в более стройный, быстрый и безопасный “организм”, способный выдержать невероятные аппетиты искусственного интеллекта.

Пора задуматься, насколько готова ваша инфраструктура к этому шагу вперёд. Выбор правильных инструментов сегодня определит, сможете ли вы завтра обеспечить необходимые производительность и масштаб для AI-задач. DPU и SmartNIC – это не модные слова, а реальная технология, которая помогает архитектуре эволюционировать. Настало время присмотреться к ней повнимательнее: возможно, именно правильно подобранный ускоритель станет тем самым звеном, которого не хватает вашей AI-платформе для рывка в будущее. Пусть ваш CPU летает, GPU творит чудеса машинного обучения, а заботы о данных доверены надёжному DPU – и тогда инфраструктура действительно начнёт работать с умом и максимальной отдачей.